Глава 1. Лестница причинности

В начале…

Мне было, наверное, шесть или семь лет, когда я впервые прочел историю об Адаме и Еве в Эдемском саду. Мы с одноклассниками абсолютно не удивились капризным требованиям Бога, который запретил им есть плоды с древа познания. У божеств на все есть свои причины, думали мы. Но нас заинтриговал тот факт, что, когда Адам и Ева вкусили запретный плод, они, как и мы, стали осознавать свою наготу.

Когда мы стали подростками, наш интерес медленно сместился в сторону философских аспектов этой истории (израильские школьники читают Бытие несколько раз в год). Прежде всего нас взволновало, что возникновение человеческого знания было процессом не радостным, а болезненным – его сопровождали непослушание, вина и наказания. Некоторые спрашивали: имело ли смысл ради него отказываться от беззаботной жизни в Эдеме? И можно ли утверждать, что сельскохозяйственные и научные революции, которые случились после, стоили всех трудностей, войн и социальной несправедливости, неотъемлемых от современной жизни?

Не поймите меня неправильно: мы вовсе не были креационистами, и даже наши учителя были дарвинистами в душе. Однако мы знали, что автор, разыгравший эту историю по ролям, пытался ответить на самые насущные философские вопросы своего времени. Подобным образом мы ожидали, что она несет культурные отпечатки действительного процесса, в ходе которого Homo sapiens стал доминировать на нашей планете. Какой же в таком случае была последовательность шагов в этом скоростном процессе суперэволюции?

Интерес к таким вопросам угас, когда я на заре карьеры начал преподавать технические науки, но вдруг возродился в 1990-е годы, когда, работая над книгой «Причинность» (Causality), я познакомился с Лестницей Причинности.

Перечитывая Бытие в сотый раз, я заметил деталь, которая каким-то образом ускользала от моего внимания все эти годы. Когда Бог находит Адама, прячущегося в саду, он спрашивает: «… не ел ли ты от дерева, с которого Я запретил тебе есть?» И Адам отвечает: «… жена, которую Ты мне дал, она дала мне от дерева, и я ел». Бог спрашивает Еву: «… что ты это сделала?» Она отвечает: «… змей обольстил меня, и я ела».

Как мы знаем, Всемогущего не слишком впечатлили эти взаимные обвинения и он изгнал обоих из райского сада. И вот что я всегда пропускал до тех пор: Господь спросил: «Что?», а они ответили на вопрос «Почему?». Господь спрашивал о фактах, а они дали объяснения. Более того, оба были полностью убеждены, что, если назвать причины, их действия будут каким-то образом выставлены в ином свете. Откуда они взяли эту мысль?

Для меня из этих деталей вытекают три глубоких вывода. Во-первых, еще на заре нашей эволюции мы, люди, осознали, что мир состоит не только из фактов (которые сегодня мы назвали бы данными); скорее, эти факты склеены вместе сложной сетью причинно-следственных отношений. Во-вторых, именно объяснения причин, а не сухие факты, составляют основу наших знаний и должны быть краеугольным камнем машинного интеллекта. Наконец, наш переход от обработчиков данных к создателям объяснений был не постепенным; потребовался скачок, который нуждался во внешнем толчке в виде необычного фрукта. Это в точности соответствовало тому, что я в теории наблюдал на Лестнице Причинности: ни одна машина не сможет извлечь объяснения из необработанных данных. Ей необходим толчок.

Если искать подтверждения для этих обобщений в науке об эволюции, то мы, конечно же, не найдем древа познания, но все же увидим важный необъяснимый переход. Сейчас мы понимаем, что люди произошли от обезьяноподобных предков за период от 5 до 6 миллионов лет и что такие постепенные эволюционные процессы вполне свойственны земной жизни. Но около 50 тысяч лет назад случилось нечто уникальное. Одни называют это Когнитивной Революцией, а другие (с некоторой иронией) – Великим Скачком. Люди приобрели способность менять окружающую среду и собственные возможности с принципиально иной скоростью.

Например, за миллионы лет эволюции у орлов и сов развилось потрясающее зрение, однако они так и не изобрели очки, микроскопы, телескопы или приборы ночного видения. Люди произвели эти чудеса в течение столетий. Я называю такой феномен суперэволюционным ускорением. Некоторые читатели могут возразить, утверждая, что я сравниваю абсолютно разные вещи – эволюцию и развитие техники, но в том-то и дело. Эволюция снабдила нас способностью внедрять технику в жизнь – дар, которым она не наделила орлов и сов, и здесь снова встает вопрос: почему? Как вычислительные навыки вдруг появились у людей, но не у орлов?

На этот счет было предложено много гипотез, но одна из них особенно тесно связана с идеей причинности. В книге «Sapiens: Краткая история человечества» Юваль Ной Харари постулирует, что способность наших предков воображать несуществующее стала ключевой, поскольку улучшила коммуникацию. До этого сдвига они могли доверять только людям из своей непосредственной семьи или племени. Потом их доверие распространилось на более крупные сообщества, объединенные общими фантазиями (например, верой в невидимых, но доступных воображению божеств, в загробную жизнь и в божественную сущность лидера) и ожиданиями. Согласитесь вы с гипотезой Харари или нет, но связь между воображением и причинными отношениями практически самоочевидна. Бесполезно говорить о причинах вещей, если вы не можете представить их последствий. Верно и обратное: нельзя утверждать, что Ева вынудила вас съесть плод с дерева, если вы не способны вообразить мир, в котором, вопреки фактам, она не дала вам яблока.

Но вернемся к нашим предкам Homo sapiens: новообретенная способность мыслить в категориях причинности позволила им делать много вещей эффективнее с помощью непростого процесса, который мы называем планированием. Представьте себе племя, которое готовится к охоте на мамонта. Что им потребуется для успеха? Признаться, я не лучший охотник на мамонтов, но, изучая думающие машины, я узнал одну вещь: думающая сущность (компьютер, пещерный человек или преподаватель вуза) способна выполнить задачу такого размаха, только если запланирует все заранее – решит, сколько охотников надо привлечь, оценит с учетом направления ветра, с какой стороны лучше приближаться к мамонту – в общем, вообразит и сравнит последствия нескольких стратегий охоты. Чтобы это сделать, думающая сущность должна обладать ментальной моделью реальности, сверяться с ней и манипулировать ей.

Рис. 2. Предполагаемые причины успеха в охоте на мамонта

Рисунок 2 показывает, как нарисовать такую модель в уме. Каждая точка на рисунке представляет собой причину успеха. Заметьте, что причин много и что ни одна из них не будет определяющей; т. е. мы не можем быть уверены, что большее число охотников обеспечит успех или что дождь гарантирует неудачу, однако эти факторы действительно влияют на вероятность успеха.

Ментальная модель – это арена, на которой работает воображение. Она позволяет экспериментировать с разными сценариями, внося изменения в конкретные места. Где-то в ментальной модели наших охотников был вспомогательный элемент, который позволял оценить эффект от числа участников. Когда они размышляли, стоит ли взять больше людей, им не приходилось оценивать все остальные факторы с нуля. Они могли внести локальное изменение в модель, поставив «Охотники = 9» вместо «Охотники = 8», и снова оценить вероятность успеха. Этот модульный состав – основное свойство причинных моделей.

Я, конечно же, не хочу сказать, что первые люди рисовали себе модель, похожую на эту. Но когда мы пытаемся имитировать человеческую мысль на компьютере или даже когда хотим решить новые научные задачи, рисование картинок с конкретными точками и стрелками всегда исключительно полезно. Эти диаграммы причинности – вычислительная суть механизма причинного вывода, который я описал во вступлении.

Три уровня причинности

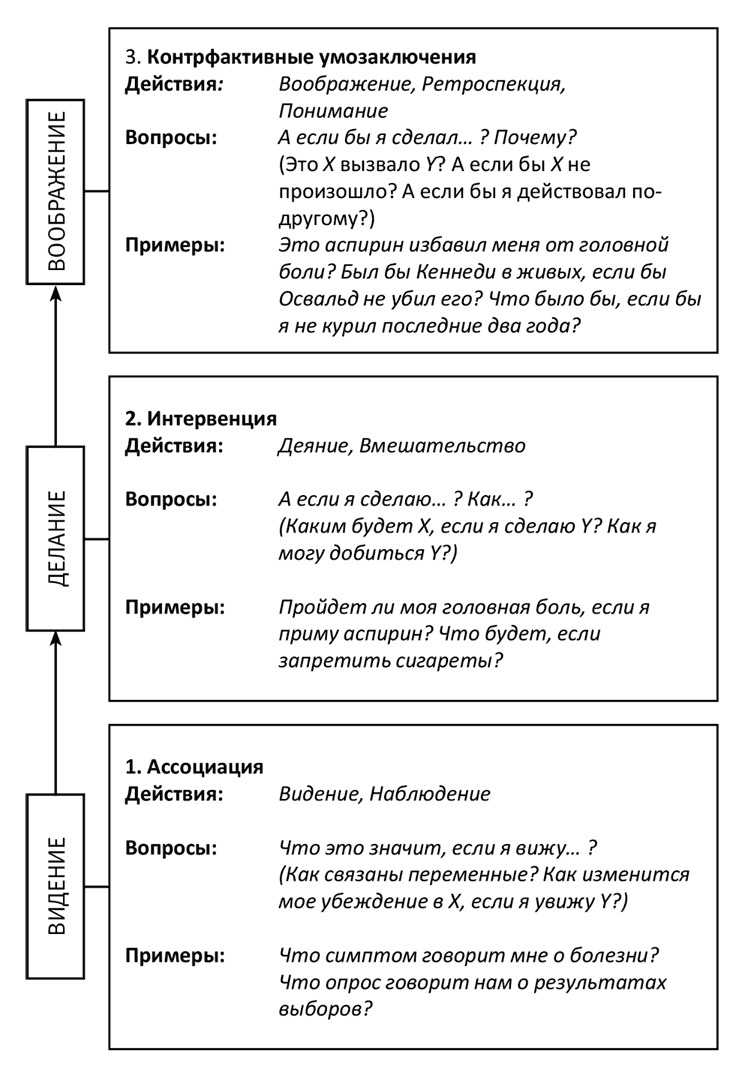

Возможно, к этому моменту я создал впечатление, что способность организовывать знания, деля их на причины и следствия, едина и мы приобрели ее сразу. На самом деле, исследуя машинное обучение, я узнал, что для изучения причинно-следственных связей необходимо овладеть когнитивными навыками по крайней мере на трех конкретных уровнях – видения, делания и воображения.

Первый навык, видение или наблюдение, подразумевает умение определять закономерности в окружающей среде. Он присутствует у многих животных и был у первых людей до Когнитивной Революции. Второй навык, делание, связан с умением предсказывать, какой эффект вызовут намеренные изменения в окружающей среде, и выбирать, какие изменения надо внести, чтобы получить желаемый результат. Очень немногие виды продемонстрировали элементы этого навыка. Использование инструментов, если это сознательные действия, а не случайность и не копирование предков, может свидетельствовать о переходе на этот следующий уровень. Но даже у пользователей инструментов не всегда есть «теория», которая говорит, почему инструмент работает и что делать, если он не работает. Для этого необходимо достичь уровня понимания, который допускает воображение. Именно этот третий уровень в первую очередь подготовил нас к дальнейшим революциям в науке и сельском хозяйстве и резко преобразил воздействие нашего вида на планету.

Это я обосновать не могу, зато могу доказать математически, что три уровня фундаментально различны, и на каждом из них раскрываются способности, которых нет на предыдущих. Схема, которую я использую для демонстрации, восходит к Алану Тьюрингу, пионеру в исследовании искусственного интеллекта, предложившему классифицировать когнитивную систему, ориентируясь на вопросы, на которые она способна ответить. Такой подход оказался исключительно плодотворным, если говорить о причинности, потому что он позволяет избежать долгих и непродуктивных дискуссий о том, что именно представляет собой причинность, и сосредоточен на конкретном вопросе, на который реально ответить: что делает мыслитель, изучающий причинность? Или, если точнее, что может вычислить организм, имеющий модель причинности, тогда как организм, не имеющий модели причинности, это вычислить не в состоянии?

В то время как Тьюринг хотел создать бинарную классификацию, чтобы отличать человека от нечеловека, у нашей есть три уровня, соответствующих все более и более сложным причинным запросам. Используя эти критерии, можно собрать из запросов трех уровней одну Лестницу Причинности (рис. 3.) Мы будем еще не раз возвращаться к этой метафоре.

Давайте подробно рассмотрим каждую ее перекладину. На первом уровне – ассоциаций – мы ищем повторяющиеся детали в наблюдениях. Этим занимается сова, которая наблюдает, как двигается крыса, и анализирует, где грызун окажется через секунду. Этим же занимается компьютерная программа для игры в го – она изучает базу данных с миллионами игр и может вычислить, какие ходы связаны с более высоким процентом выигрыша. Мы говорим, что одно событие связано с другим, если наблюдение одного изменения повышает вероятность увидеть другое.

Рис. 3. Лестница Причинности с представляющими ее организмами на каждом уровне. Большинство животных, так же как и сегодняшние обучающиеся машины, находятся на первой перекладине – они учатся по ассоциации. Пользователи инструментов вроде первых людей находятся на второй перекладине – если действуют по плану, а не просто имитируют. Кроме того, на этом уровне можно ставить эксперименты, чтобы узнать, какой эффект дает интервенция. Предположительно именно так младенцы получают большинство знаний о причинности. Те же, кто учится с помощью контрфактивных рассуждений, находятся на верхней перекладине и могут вообразить несуществующие миры и назвать причины для наблюдаемых феноменов.

Первая перекладина лестницы подразумевает предсказания, основанные на пассивных наблюдениях. Ее характеризует вопрос: «Что, если я увижу…?» Например, представьте директора по маркетингу в универмаге, который спрашивает: «Какова вероятность, что потребитель, который купил зубную пасту, также приобретет зубную нить?» Такие вопросы – самая суть статистики, и на них отвечают прежде всего, собирая и анализируя данные. В нашем случае на этот вопрос получится ответить, взяв данные о покупательском поведении всех клиентов, выбрав тех, кто купил зубную пасту, и, сосредоточившись на последней группе, вычислить долю тех, кто приобрел еще и зубную нить. Эта пропорция, также известная как условная вероятность, измеряет (для больших объемов данных) степень связи между покупкой пасты и покупкой зубной нити. Мы можем записать это в символах как P (зубная нить | зубная паста). P обозначает вероятность, вертикальная линия – «при условии, что вы видите».

Статистики предложили много изощренных методов, которые позволяют сократить большой объем данных и выявить связи между переменными. Корреляция или регрессия – типичная мера взаимосвязи, которая часто упоминается в этой книге. Чтобы увидеть ее, необходимо провести линию, ориентируясь на распределение единиц наблюдения, и продолжить ее уклон. Некоторые связи имеют очевидную интерпретацию с точки зрения причинности; другие могут ее не иметь. Но одна только статистика не скажет нам, что причина, а что следствие – зубная паста или зубная нить. С точки зрения менеджера по продажам это может не иметь особого значения. Точные предсказания не нуждаются в хороших объяснениях. Сова отлично охотится, не понимая, почему крыса всегда движется из точки A в точку B.

Некоторые читатели могут быть удивлены тем, что я разместил обучающиеся машины наших дней прямо на первой перекладине Лестницы Причинности – рядом с мудрой совой. Такое ощущение, что почти каждый день мы слышим о стремительном прогрессе систем машинного обучения – о самоуправляемых автомобилях, системах распознавания речи и, особенно в последнее время, об алгоритмах глубинного обучения (или глубинных нейросетях). Как же они могут до сих пор оставаться на первом уровне?

Успехи глубинного обучения стали по-настоящему примечательными и оказались сюрпризом для многих из нас. В то же время глубинное обучение оказалось успешным в основном потому, что показало: определенные вопросы или задания, которые мы считали трудными, на самом деле не являются таковыми. Оно не коснулось по-настоящему сложных вопросов, которые до сих пор не дают нам создать искусственный интеллект, подобный человеческому. В результате общественность верит, что машины с «сильным ИИ», которые думают, как человек, вот-вот появятся или, возможно, уже появились. В реальности это максимально далеко от правды. Я полностью согласен с Гэри Маркусом, нейроученым из Нью-Йоркского университета, который недавно писал в «Нью-Йорк таймс» о том, что сфера искусственного интеллекта «полнится микрооткрытиями», которых хватает для хороших пресс-релизов, но машины все еще огорчительно далеки от познания, подобного человеческому. Мой коллега Эднан Дарвиш, специалист по компьютерным наукам из Калифорнийского университета в Лос-Анджелесе, назвал свою программную статью «Интеллект как у человека или способности как у животных?» и, я думаю, очень точно поставил в ней интересующий нас вопрос. Сильный искусственный интеллект нужен для того, чтобы производить машины с интеллектом, подобным человеческому, которые будут способны общаться с людьми и направлять их. В то же время глубинное обучение дает нам машины с действительно впечатляющими способностями, но без интеллекта. Разница здесь глубокая, и ее причина – отсутствие модели реальности.

Точно так же, как 30 лет назад, программы машинного обучения (включая программы с глубинными нейросетями) практически всегда действуют в режиме ассоциаций. Они используют поток наблюдений, к которым пытаются приспособить функцию, по существу как статистик, который старается увидеть линию в скоплении точек – единиц информации. Глубинные нейросети повышают сложность подобранной функции, добавляя много слоев, но процесс подбора до сих пор базируется на необработанных данных. Чем больше данных используется, тем выше становится точность, но «суперэволюционного ускорения» не происходит. Если, например, программисты беспилотной машины захотят, чтобы она по-разному реагировала на новые ситуации, им придется быстро добавить эти новые реакции. Машина сама не поймет, что пешеход с бутылкой виски в руке, вероятно, по-своему отреагирует на сигнал. Это отсутствие гибкости и приспособляемости неизбежно для любой системы, которая работает на первом уровне нашей Лестницы Причинности.

Мы переходим на следующую ступень запросов о причинности, когда начинаем менять мир. Обычный вопрос для этого уровня будет таким: «Как изменятся продажи зубной нити, если удвоить стоимость зубной пасты?». Это уже требует нового вида знаний, которого нет в наших данных, обнаруженных на втором уровне Лестницы Причинности – интервенции.

Интервенция стоит выше ассоциации, потому что подразумевает не только наблюдение, но и изменение. Когда мы видим дым и когда дымим сами, это подразумевает совершенно разное представление о вероятности пожара. На вопросы об интервенции нельзя ответить с помощью пассивно собранных данных, и неважно, насколько велик их объем или насколько глубока нейронная сеть. Для многих ученых стала настоящим ударом информация о том, что никакие методы, известные из статистики, не позволяют даже выразить простой вопрос, например «Что будет, если мы удвоим цену?», не говоря уже о его решении. Я знаю это, поскольку много раз помогал им подняться на следующую перекладину лестницы.

Почему нельзя ответить на вопрос о зубной нити просто при помощи наблюдения? Ведь можно заглянуть в нашу обширную базу данных о предыдущих покупках, посмотреть, что было раньше, когда зубная паста стоила в два раза больше? Причина в том, что в предыдущих случаях цена могла быть выше по другим причинам. Предположим, товара осталось немного и всем остальным магазинам тоже пришлось повысить цены. Но теперь вы размышляете о намеренном вмешательстве, после которого установится новая цена, независимо от условий на рынке. Результат может сильно отличаться от предыдущего, когда покупатель не мог купить товар по более выгодной цене в других местах. Если бы у вас были данные об условиях на рынке в других ситуациях, вероятно, вы смогли бы предсказать все это лучше, но какие данные нужны? И как это выяснить? Наука о причинном выводе позволяет нам отвечать именно на эти вопросы.

Непосредственный способ предсказать результат интервенции – провести с ней эксперимент в тщательно контролируемых условиях. Компании, работающие с большими данными, такие как «Фейсбук», знают об этом и постоянно ставят эксперименты, чтобы посмотреть, что случится, если по-другому разместить элементы на экране или показать клиенту новую подсказку (либо даже новую цену).

Еще интереснее тот факт, что успешные предсказания об эффекте интервенции иногда можно сделать даже без эксперимента, хотя это не так широко известно, и даже в Кремниевой долине. Предположим, менеджер по продажам создает модель потребительского поведения и учитывает в ней ситуацию на рынке. Если данных обо всех факторах не имеется, вероятно, получится подставить достаточно суррогатных ключей и сделать прогноз. Сильная и точная причинная модель позволит использовать данные с первого уровня (наблюдения), чтобы ответить на запросы со второго уровня (об интервенции). Без причинной модели нельзя перейти с первой перекладины Лестницы на вторую. Вот почему системы глубинного обучения (если в них используются только данные с первой перекладины и нет причинной модели) никогда не смогут отвечать на вопросы об интервенции, по определению нарушающие правила среды, в которой обучалась машина.

Как иллюстрируют все эти примеры, главный вопрос на второй перекладине Лестницы Причинности – «Что, если мы…?». Что произойдет, если мы изменим среду? Можно написать запрос P (нить | do (зубная паста)), чтобы узнать, какова вероятность продать зубную нить по определенной цене, если мы будем продавать зубную пасту по другой цене.

Еще один популярный вопрос на этом уровне причинности – «Как?» Это родственник вопроса «Что, если мы…?». Скажем, менеджер говорит нам, что на складе слишком много зубной пасты. Он спрашивает: «Как нам ее продать?», т. е. какую цену лучше на нее назначить. И снова вопрос относится к интервенции, которую нужно совершить в уме, прежде чем решить, стоит ли осуществлять ее в реальной жизни и как это осуществить. Здесь требуется модель причинности.

В повседневной жизни мы постоянно совершаем интервенции, хотя обычно не называем их таким замысловатым термином. Предположим, принимая аспирин, чтобы избавиться от головной боли, мы вмешиваемся в одну переменную (количество аспирина в нашем организме), чтобы повлиять на другую (состояние головной боли). Если наш причинный взгляд на аспирин верен, то переменная результата отреагирует, изменившись с «головной боли» на «отсутствие головной боли».

Хотя рассуждения об интервенциях – важный уровень на Лестнице Причинности, все же они не отвечают на все интересующие нас вопросы. Можно задуматься: головная боль прошла, но почему? Помог аспирин? Или что-то из еды? Хорошие новости, которые я услышал? Эти вопросы приводят нас на верхний уровень Лестницы Причинности – уровень контрфактивных суждений, потому что для ответа на них нужно вернуться в прошлое, изменить историю и спросить себя: что случилось бы, если бы я не принял аспирин? Никакой эксперимент в мире не может отменить лечение человеку, который уже исцелился, и не позволит сравнить два исхода, поэтому необходимо применить совершенно новый вид знания.

Контрфактивные суждения находятся в особенно проблематичных отношениях с данными, потому что последние по определению относятся к фактам. Они не могут сообщить нам, что случится в контрфактивном или воображаемом мире, где некоторые наблюдаемые факты резко отвергаются. Но все же человеческий разум производит логические рассуждения такого рода – постоянно и с высокой надежностью. Это сделала Ева, когда обозначила причину своих действий: «Змей обольстил меня». Такая способность больше всего отличает человеческий интеллект от интеллекта животного, равно как и от невосприимчивых к подобным моделям версий ИИ и обучающихся машин.

Вероятно, вам не верится, что наука способна сделать полезные заключения в духе «а что, если» о мирах, которые не существуют, и о вещах, которые не происходили. Однако этим она и занимается – и занималась всегда. Законы физики можно рассматривать как контрфактивные утверждения, например: «Если бы вес этой спирали удвоился, ее длина тоже удвоилась бы» (закон Гука). Это утверждение, конечно, поддерживается изобилием экспериментальных подтверждений (второго уровня), полученных с помощью сотен спиралей в десятках лабораторий в тысячах случаев. Однако, поскольку утверждение нарекли законом, физики интерпретируют его как функциональную зависимость, которая управляет конкретной спиралью в конкретный момент при гипотетических значениях веса. Все эти разные миры, где вес составляет x кг, а длина спирали – LX см, рассматриваются как объективно известные и одновременно действующие, хотя на самом деле существует только один из них.

Если вернуться к примеру с зубной пастой, то вопрос на верхнем уровне будет таким: какова вероятность, что покупатель зубной пасты все равно купил бы ее, если бы мы удвоили цену? Мы сравниваем реальный мир (в котором знаем, что покупатель приобрел зубную пасту по текущей цене) с воображаемым миром (где цена вдвое выше).

Если иметь причинную модель, которая способна ответить на контрфактивные вопросы, преимущества будут огромными. Если понять причины грубой ошибки, в будущем можно будет принять меры, которые позволят все скорректировать. Если понять, почему лекарство помогло одним, но не помогло другим, получится открыть новые способы лечить болезнь. Отвечая на вопрос, как сложились бы события, если бы что-то пошло по-другому, мы извлечем уроки из истории и опыта других людей, и, кажется, ни один другой вид на это не способен. Неудивительно, что греческий философ Демокрит (около 460 – около 370 года до н. э.) сказал: «Я предпочел бы найти одну-единственную причину, чем стать персидским царем».

Расположение контрфактивных суждений на верхнем уровне Лестницы Причинности объясняет, почему я придаю им такое значение как ключевому моменту в эволюции человеческого создания. Я полностью согласен с Ювалем Харари в том, что описание воображаемых существ было демонстрацией новой способности, которую он называет Когнитивной Революцией. Ее классический пример – статуэтка человекольва, найденная в пещере Штадель в юго-западной Германии, которая сейчас хранится в Ульмском музее. Человеколев, созданный около 40 тысяч лет назад, представляет собой химеру, наполовину льва и наполовину человека, вырезанную из бивня мамонта.

Мы не знаем, кто создал человекольва и с какой целью это было сделано, но мы все же знаем, что это были анатомически современные люди и что это знаменует разрыв со всеми искусствами и ремеслами, практиковавшимися прежде. Раньше люди изготовляли инструменты и предметы фигуративного искусства – от бусин до флейт, наконечников копий и элегантных статуэток лошадей и прочих животных. Человеколев имеет иную природу – это творение чистого воображения.

Демонстрируя нашу новообретенную способность воображать вещи, которые никогда не существовали, человеколев является предшественником всех философских теорий, научных открытий и технических инноваций – от микроскопов до самолетов и компьютеров. Все они сначала появились в чьем-то воображении, а уже потом воплотились в физическом мире.

Этот скачок когнитивных возможностей был таким же глубоким и важным для нашего вида, как и все анатомические изменения, которые сделали нас людьми. В течение 10 тысяч лет после создания человекольва все иные виды рода Homo (кроме очень изолированного географически человека флоресского) вымерли. А люди продолжили менять естественный мир с невероятной скоростью, используя воображение, чтобы выжить, приспособиться и в итоге доминировать. Преимущество, которое мы получили, воображая контрфактивные ситуации, было тем же, что и сегодня: оно давало гибкость, способность размышлять и совершенствоваться на основе действий в прошлом и, что, вероятно, еще важнее, готовность брать на себя ответственность за действия в прошлом и будущем.

Как показано на рис. 3, для третьего уровня Лестницы Причинности характерны запросы вроде «Что было бы, если бы я сделал…?» и «Почему?». Оба подразумевают сравнение наблюдаемого мира с контрфактивным миром. Эксперименты сами по себе не позволяют отвечать на такие вопросы. В то время как на первом уровне мы имеем дело с наблюдаемом миром, а на втором уровне – с дивным новым миром, который можно увидеть, на третьем уровне идет взаимодействие с миром, который увидеть нельзя (потому что он противоречит наблюдаемому). Чтобы преодолеть этот разрыв, необходима модель причинного процесса, который иногда называют теорией или (когда мы невероятно уверены в себе) законом природы. Короче говоря, нам необходимо понимание. Это, конечно же, святой Грааль любой науки – разработка теории, которая позволит нам предсказать, что случится в ситуациях, которые мы даже не предвидели. Но дело заходит еще дальше: присутствие таких законов позволяет нам выборочно нарушать их, чтобы создать мир, который противоречит нашему. В следующем разделе мы рассмотрим такие нарушения на практике.

Мини-тест Тьюринга

В 1950 году Алан Тьюринг задался вопросом, что это значит: компьютер, думающий как человек. Он предложил практический тест под названием «Игра в имитацию», но исследователи искусственного интеллекта с тех пор зовут его исключительно тестом Тьюринга. Во всех практических отношениях компьютер достоин считаться думающей машиной, если обычный человек, который общается с ним при помощи клавиатуры, не догадается, с кем он разговаривает – с другим человеком или с компьютером. Тьюринг был горячо уверен в том, что это абсолютно достижимо. Он писал: «Я верю, что примерно через 50 лет можно будет так хорошо программировать компьютеры для игры в имитацию, что после пяти минут вопросов и ответов у среднего собеседника будет не более 70 %-ного шанса сделать правильный выбор».

Предсказание Тьюринга оказалось немного неточным. Ежегодно самый похожий на человека чатбот в мире борется за премию Лёбнера: за программу, которая сумеет обмануть всех четырех судей, притворяясь человеком, полагается золотая медаль и 100 тысяч долларов. В 2015 году, спустя 25 лет с начала соревнований, ни одной программе не удалось обмануть не то что всех судей, но даже и половину.

Тьюринг не просто разработал игру в имитацию, он также предложил стратегию, чтобы пройти тест. «Что, если разработать программу, симулирующую не разум взрослого человека, а ум ребенка?» – спросил он. Если это сделать, можно было бы обучить ее так, как мы обучаем детей, – и вуаля! Через 20 лет (или меньше, учитывая более высокую скорость компьютера) мы получим искусственный интеллект. «Можно предположить, что ум ребенка подобен тетради, которую покупают в канцелярском магазине, – писал он. – Совсем небольшой механизм и много пустых страниц». Здесь он ошибался: мозг ребенка богат механизмами и заранее загруженными шаблонами.

И все же я думаю, что в чем-то Тьюринг прав. Скорее всего, у нас не получится произвести интеллект, подобный человеческому, пока мы не создадим интеллект, схожий с детским, и главным компонентом этого интеллекта будет владение причинно-следственными связями.

Как же машины могут получить знания о причинно-следственных связях? Это и по сей день остается важнейшим вызовом, который, несомненно, относится к замысловатым сочетаниям данных, поступающих из активных экспериментов, пассивного наблюдения и (не в последней степени) самого программиста, что во многом похоже на входящую информацию, которую получает ребенок, только эволюцию, родителей и товарищей заменяет программист.

Тем не менее ответим на несколько менее амбициозный вопрос: как машины (и люди) могли бы представить знания о причинно-следственных связях таким образом, чтобы быстро получать доступ к нужной информации, правильно отвечать на вопросы и делать это с такой же легкостью, с какой это получается у трехлетнего ребенка? На самом деле таков главный вопрос, который мы рассмотрим в этой книге.

Я называю это мини-тестом Тьюринга. Идея здесь в том, чтобы взять простую историю, каким-то образом закодировать ее на машине, а потом проверить, сможет ли она правильно ответить на вопросы о причинно-следственных связях, на которые способен ответить человек. Это мини-тест по двум причинам. Во-первых, потому что он сведен к рассуждениям о причинах и следствиях, что исключает остальные аспекты человеческого интеллекта, такие как общая картина мира и естественный язык. Во-вторых, мы позволяем конкурсанту закодировать историю в виде любого удобного представления и освобождаем машину от задачи извлечь историю из собственного опыта. Проходить этот мини-тест стало задачей всей моей жизни – я делаю это сознательно последние 25 лет и делал бессознательно раньше.

Очевидно, готовясь к мини-тесту Тьюринга, мы должны сначала ответить на вопрос о репрезентации, а уже потом – об усвоении информации. Без репрезентации мы не знали бы, как хранить данные для использования в будущем. Даже если бы мы могли дать роботу манипулировать окружающей средой по его желанию, любая информация, полученная таким образом, забылась бы, если бы роботу не дали шаблон, чтобы закодировать результаты этих манипуляций. Важнейшим вкладом ИИ в исследование познания стала парадигма «Сначала репрезентация – потом усвоение». Часто поиск хорошей репрезентации приводил к ценным находкам о том, как стоит получать знания – и из данных, и от программиста.

Когда я описываю мини-тест Тьюринга, в ответ мне обычно утверждают, что его легко пройти с помощью обмана. Например, можно взять список всех вероятных вопросов, сохранить правильные ответы, а потом привести их по памяти, когда вас спросят. И тогда не будет способа отличить машину, в которой всего лишь хранится список вопросов и ответов, от машины, которая отвечает так же, как мы с вами, т. е. понимает вопрос и производит ответ, используя ментальную модель причинности. И что же докажет мини-тест Тьюринга, если жульничать так просто?

Философ Джон Сёрл в 1980 году описал эту возможность обмана с помощью мысленного эксперимента под названием «Китайская комната». Он подверг сомнению утверждение Тьюринга о том, что способность сымитировать интеллект равна обладанию им. С аргументом Сёрла есть только одна проблема: обмануть тест нелегко, более того, это нереально. Даже при ограниченном наборе переменных количество вероятных вопросов растет астрономически. Скажем, у нас есть 10 каузальных переменных и каждая из них может иметь два значения (0 или 1). Мы способны задать около 30 миллионов предполагаемых запросов, например: «Какова вероятность, что результат будет равен 1, если мы увидим